Deepfakes et IA : comment les reconnaître et se protéger en 2026

Les deepfakes générés par IA sont de plus en plus difficiles à détecter. Guide complet : comment identifier une vidéo ou photo IA, outils de détection, arnaques et protection.

En 2026, une vidéo montrant un homme politique faisant une annonce choquante, une photo compromettante d’une personnalité publique, un appel vidéo de votre “banquier” vous demandant de valider un virement — rien de tout cela n’est forcément réel. Les deepfakes générés par intelligence artificielle ont atteint un niveau de réalisme qui rend leur détection à l’œil nu presque impossible. Dans ce guide, on vous donne les clés pour identifier les contenus falsifiés et vous protéger des arnaques.

Qu’est-ce qu’un deepfake ?

Le terme “deepfake” combine “deep learning” (apprentissage profond) et “fake” (faux). Un deepfake est un contenu synthétique — photo, vidéo, audio ou combinaison des trois — généré ou manipulé par une IA pour faire croire qu’une personne réelle a dit ou fait quelque chose qui n’a jamais eu lieu.

L’évolution terrifiante de la technologie

2017-2019 : Les premiers deepfakes, identifiables par leurs artefacts visuels (clignements anormaux, contours flous, cohérence lumineuse défectueuse). Requéraient des heures de calcul et des compétences techniques avancées.

2020-2022 : Démocratisation avec des outils accessibles au grand public. Qualité encore imparfaite mais suffisante pour tromper sur les petits écrans des réseaux sociaux.

2023-2024 : Sora, Runway, Kling et leurs équivalents. Des vidéos réalistes générables en quelques secondes par n’importe qui avec un compte email. Le point de bascule.

2025-2026 : Deepfakes en temps réel dans les appels vidéo. Des outils comme VASA-1 (Microsoft) permettent de modifier son apparence en direct pendant une visioconférence. La ligne entre réel et artificiel s’efface.

Les 5 types de deepfakes les plus courants

1. Le face swap vidéo

Remplacement du visage d’une personne dans une vidéo par celui d’une autre. Technique utilisée dans les arnaques aux célébrités (fausses publicités pour des investissements), les escroqueries sentimentales et la désinformation politique.

2. Les voix clonées

À partir de seulement quelques secondes d’audio, des outils comme ElevenLabs ou VALL-E peuvent cloner une voix avec une précision troublante. Utilisé pour des arnaques au “faux dirigeant” (appel prétendant être le PDG pour valider un virement) ou pour générer de fausses déclarations.

En 2025, une entreprise hongkongaise a perdu 25 millions de dollars après un appel vidéo où tous les participants — sauf la victime — étaient des deepfakes de collègues réels.

3. Les photos synthétiques

Générées entièrement par IA (DALL-E, Midjourney, Stable Diffusion), ces “personnes qui n’existent pas” sont utilisées pour créer de faux profils sur les réseaux sociaux, alimenter des campagnes de désinformation ou créer de faux témoignages.

4. Les deepfakes audio dans les appels téléphoniques

Des arnaques ciblant les personnes âgées utilisent la voix clonée d’un proche (enfant, petit-enfant) qui prétend être en urgence et a besoin d’argent immédiatement.

5. Les documents falsifiés

Photos d’identité générées par IA pour créer de faux documents, selfies synthétiques pour contourner les vérifications KYC (Know Your Customer) des banques et plateformes financières.

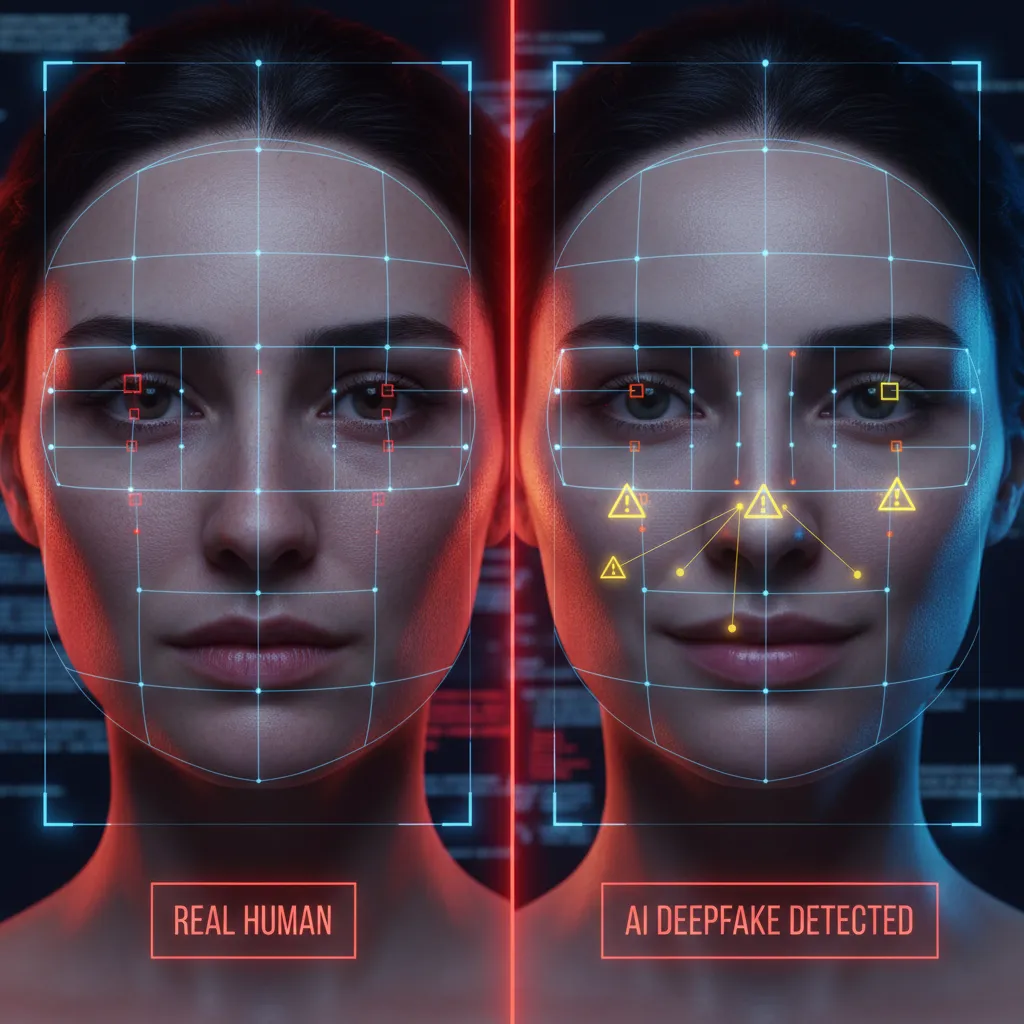

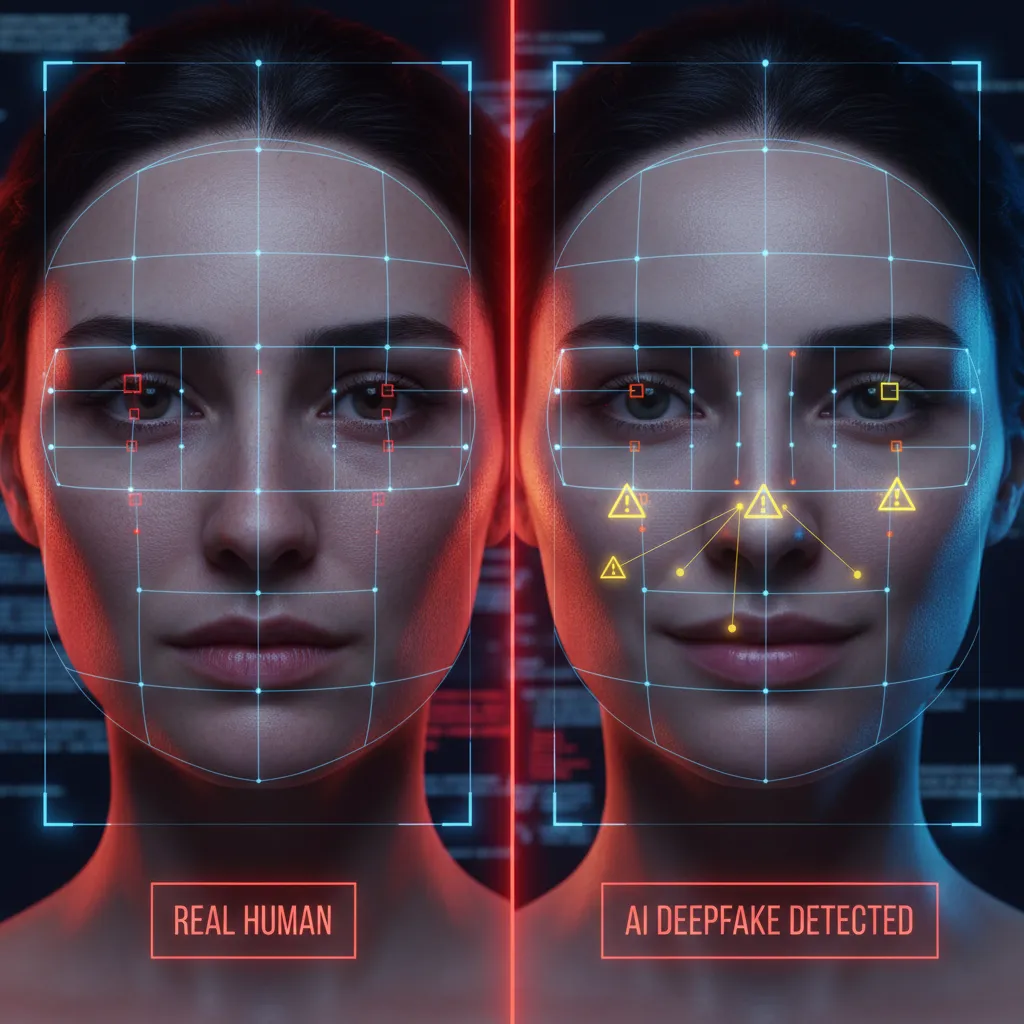

Comment reconnaître un deepfake : les signes à observer

Sur les vidéos

Les yeux et les clignements Les modèles anciens avaient du mal à reproduire les clignements naturels. Les modèles récents font mieux, mais regardez : clignements à une fréquence normale ? Regard qui suit naturellement les mouvements ?

La peau et les textures Zoom sur la peau au niveau du cou, des oreilles et de la limite cheveux/front. Les deepfakes produisent souvent une peau trop lisse, trop uniforme, avec un flou anormal sur les bords du visage.

Les dents et l’intérieur de la bouche Particulièrement difficile à reproduire pour les IA. Les dents peuvent paraître floues, mal formées ou avec une lumière incohérente.

La cohérence lumineuse La lumière sur le visage suit-elle la même direction que la lumière dans la scène ? Un visage éclairé différemment du reste de la scène est un signal fort.

Les mouvements de tête brusques Les générateurs IA ont souvent du mal avec les rotations rapides de la tête. La qualité se dégrade sur les profils et les mouvements dynamiques.

Le flou de mouvement Regardez le contour du visage lors des mouvements. Un flou anormal ou l’apparition d’artefacts lors des déplacements est suspect.

Sur les photos

Les oreilles asymétriques La génération IA a souvent du mal à créer des oreilles parfaitement symétriques et détaillées.

Les arrière-plans incohérents Bâtiments avec des fenêtres qui disparaissent, texte illisible dans l’arrière-plan, objets déformés ou incomplets.

Les mains Le nombre de doigts, leur proportion et leur articulation restent difficiles à reproduire parfaitement. Cinq doigts bien formés sont un bon signe de réalité.

Les lunettes et bijoux Reflets inhabituels dans les lunettes, bijoux qui disparaissent partiellement.

Les métadonnées EXIF Une photo authentique a généralement des métadonnées EXIF (appareil photo utilisé, lieu, date). Les images IA n’en ont pas, ou ont des métadonnées modifiées. Pour mieux comprendre les caractéristiques techniques des appareils photo et ce que révèlent ces métadonnées, Digital Cameras Info est une référence utile.

Sur les audios

Les artefacts de compression Les voix clonées ont souvent une qualité audio légèrement différente — trop parfaite, sans les bruits de fond naturels habituels.

Le rythme de la parole Les clones vocaux peuvent avoir un rythme légèrement mécanique sur les mots difficiles ou les noms propres inhabituels.

La cohérence émotionnelle Une voix IA manque souvent de la variabilité émotionnelle naturelle — les montées et descentes d’intonation qui accompagnent les émotions réelles.

Les outils de détection de deepfakes

Outils gratuits

Hive Moderation (hivemoderation.com) Détecte les images générées par IA avec un score de confiance. Fonctionne sur images et vidéos. API disponible. Très bon taux de détection sur DALL-E, Midjourney et Stable Diffusion.

Illuminarty (illuminarty.ai) Analyse les images pour détecter les signatures IA. Interface simple, résultats en quelques secondes. Gratuit pour un usage limité.

AI or Not (aiornot.com) Outil simple : téléchargez une image et obtenez une probabilité que ce soit généré par IA. Particulièrement bon sur les portraits.

Intel FakeCatcher Intel a développé un détecteur temps réel de deepfakes vidéo basé sur l’analyse des flux sanguins dans le visage (imperceptibles à l’œil mais détectables par IA). Disponible pour les partenaires commerciaux.

Les métadonnées C2PA

La Coalition for Content Provenance and Authenticity (C2PA) est un standard industriel adopté par Adobe, Microsoft, Google et OpenAI. Il intègre des métadonnées cryptographiques dans les contenus générés par IA, permettant de prouver leur origine.

Comment l’utiliser : Le site contentcredentials.org permet de vérifier si une image ou vidéo contient des métadonnées C2PA et donc d’identifier si elle a été générée par IA ou modifiée.

Limitation majeure : Seuls les contenus générés par des outils qui ont implémenté C2PA seront marqués. Les outils malveillants ne l’utilisent pas.

Les arnaques les plus courantes en 2026

L’arnaque au faux CEO (BEC avec deepfake)

Comment ça marche : L’escroc crée un deepfake vidéo/audio du PDG ou d’un dirigeant d’une entreprise, l’appelle pour une “réunion urgente” et demande de valider un virement ou de fournir des accès système.

Comment se protéger : Mettre en place un mot de code verbal préétabli avec les personnes habilitées à demander des virements urgents. Rappeler systématiquement sur un numéro connu (pas celui de l’appelant) pour vérifier.

L’arnaque sentimentale (romance scam)

Un faux profil créé avec des photos IA synthétiques établit une relation de confiance sur les réseaux sociaux ou applications de rencontres, puis demande de l’argent pour une “urgence”.

Signes d’alerte : Refus de vidéoconférence spontanée, photos trop parfaites, histoire de vie trop romanesque, accélération rapide de la relation, demande d’argent.

Les fausses célébrités en cryptomonnaies

Des deepfakes de célébrités (Elon Musk, Warren Buffett, personnalités locales) font la promotion de faux investissements en cryptomonnaies avec des promesses de rendements impossibles.

Règle d’or : Aucune personnalité légitime ne vous contactera pour vous proposer un investissement. Si vous voyez une vidéo d’une célébrité promouvant un investissement, c’est un deepfake.

Les appels d’urgence familiaux

“Grand-maman, c’est moi [nom de votre petit-enfant], j’ai eu un accident, il faut m’envoyer de l’argent rapidement.”

Comment se protéger : Établissez un mot de code familial que vos proches peuvent utiliser pour confirmer leur identité en cas d’urgence réelle. Raccrochez et rappelez sur le numéro que vous connaissez.

Les implications sociétales et politiques

La désinformation électorale

Les deepfakes représentent une menace directe pour les démocraties. Des fausses vidéos de candidats faisant des déclarations inventées peuvent influencer des élections si elles circulent massivement dans les jours précédant un scrutin.

Lors des élections de 2024, plusieurs pays ont observé des deepfakes de personnalités politiques circuler sur WhatsApp et Telegram — souvent trop tard pour les démentir efficacement.

La “liar’s dividend”

Un effet pervers des deepfakes : même des contenus authentiques peuvent désormais être niés en prétextant qu’il s’agit d’un deepfake. Cette “prime au menteur” érode la confiance dans l’ensemble des médias visuels.

Pour en savoir plus sur les implications de l’IA sur la société, consultez notre article sur l’IA et l’emploi et notre récapitulatif des actualités IA 2026.

Les réponses réglementaires

Union Européenne — AI Act (2024) : L’AI Act européen oblige à marquer explicitement les contenus générés par IA et interdit certains usages deepfake (usurpation de personnalité publique à des fins de désinformation). Entrée en vigueur progressive jusqu’en 2027.

France : La loi Sren (2024) oblige les plateformes à mettre en place des mécanismes de signalement des deepfakes et impose des amendes pour les plateformes qui ne réagissent pas rapidement aux signalements.

États-Unis : Plusieurs États ont adopté des lois spécifiques sur les deepfakes politiques et les deepfakes pornographiques non consentis. Pas encore de loi fédérale unifiée.

Comment se protéger : checklist pratique

Pour vous-même :

- ✅ Limitez les photos et vidéos publiques de vous disponibles en ligne

- ✅ Activez les paramètres de confidentialité maximaux sur vos réseaux sociaux

- ✅ Configurez une alerte Google sur votre nom pour détecter du contenu non autorisé

- ✅ Utilisez un mot de passe unique + 2FA sur tous vos comptes

Pour votre famille :

- ✅ Établissez un mot de code familial pour les urgences

- ✅ Expliquez les arnaques deepfake aux personnes vulnérables (personnes âgées, enfants)

- ✅ Rappel : votre banque ne vous appellera JAMAIS pour demander vos codes

Pour votre entreprise :

- ✅ Formation des équipes financières aux arnaques au faux CEO

- ✅ Protocole de double validation pour les virements > X€ (indépendamment du canal de communication)

- ✅ Mot de code verbal pour les demandes urgentes inhabituelles

Pour aller plus loin sur la protection de votre vie numérique au quotidien, Cyberclinique propose des guides pratiques sur la cybersécurité accessibles à tous.

Pour approfondir votre culture IA et mieux comprendre ces technologies, consultez notre guide ChatGPT pour débutants et notre formation au prompt engineering.

Conclusion : la confiance visuelle est morte, vive l’esprit critique

L’ère où “voir c’est croire” est révolue. En 2026, n’importe quel contenu visuel peut être synthétique. Ce n’est pas une raison de paniquer — mais c’est une raison de développer de nouveaux réflexes critiques.

Le mantra à adopter face à tout contenu suspect :

- D’où vient cette information ? (source originale, pas le partage de quelqu’un)

- Qui a intérêt à ce que je croie cela ?

- Puis-je vérifier sur d’autres sources indépendantes ?

- Les outils de détection IA confirment-ils l’authenticité ?

La technologie deepfake évolue plus vite que les outils de détection. La vraie protection reste l’esprit critique, la vérification des sources et la méfiance saine face aux contenus qui suscitent des réactions émotionnelles fortes — indignation, peur, enthousiasme excessif.

Les 3 règles d’or :

- 🚫 Ne partagez jamais sans vérifier

- 🔍 Cherchez toujours la source primaire

- 💬 En cas de doute sur une urgence familiale ou professionnelle : raccrochez et rappelez

Newsletter

Recevez chaque semaine les dernieres actualites IA, tutoriels et astuces directement dans votre boite mail.

Pas de spam. Desabonnement en un clic. Politique de confidentialite

Articles similaires

DeepSeek : l'IA chinoise qui défie ChatGPT (guide complet 2026)

DeepSeek est l'IA chinoise open source qui rivalise avec GPT-4o à une fraction du coût. Guide complet : fonctionnalités, performances, utilisation et comparatif.

Lire l'article

Mistral AI : le champion européen de l'IA (guide complet 2026)

Tout savoir sur Mistral AI, la startup française qui défie OpenAI : modèles Mistral Large, Mixtral, Le Chat, API, performances et comment l'utiliser gratuitement.

Lire l'article

Grok : l'IA d'Elon Musk qui dit ce que les autres n'osent pas

Grok est l'IA d'xAI, la startup d'Elon Musk. Guide complet : accès gratuit sur X, Grok 3, différences avec ChatGPT, mode sans filtre et pourquoi tout le monde en parle.

Lire l'article