Mistral AI : le champion européen de l'IA (guide complet 2026)

Tout savoir sur Mistral AI, la startup française qui défie OpenAI : modèles Mistral Large, Mixtral, Le Chat, API, performances et comment l'utiliser gratuitement.

Mistral AI est la startup française d’intelligence artificielle qui a fait trembler la Silicon Valley. Fondée à Paris en mai 2023 par d’anciens chercheurs de Google DeepMind et Meta, Mistral a levé plus de 1 milliard d’euros en moins d’un an et est aujourd’hui valorisée à plus de 6 milliards de dollars. Mais au-delà du buzz financier, ses modèles open source affichent des performances qui rivalisent réellement avec GPT-4. Voici tout ce que vous devez savoir sur Mistral AI en 2026.

L’histoire de Mistral AI : la startup européenne qui bouscule tout

Mistral AI a été fondée en mai 2023 par trois chercheurs :

- Arthur Mensch (ex-Google DeepMind), CEO

- Guillaume Lample (ex-Meta), qui a co-créé LLaMA

- Timothée Lacroix (ex-Meta)

Leur premier tour de table seed, d’un montant de 105 millions de dollars, a été levé avant même que la startup ait publié le moindre modèle — un record absolu dans l’écosystème IA européen.

En septembre 2023, Mistral publie son premier modèle : Mistral-7B, un modèle de 7 milliards de paramètres qui surpasse Llama 2 13B sur la quasi-totalité des benchmarks malgré une taille deux fois inférieure. La méthode de publication ? Un simple lien torrent sur Twitter — fracassant les conventions du milieu.

La montée en puissance s’est ensuite accélérée avec un financement de 385 millions de dollars en décembre 2023 (valorisation : 2 milliards) puis 600 millions supplémentaires en 2024.

Les modèles Mistral AI : panorama complet

Mistral 7B — L’outsider qui a tout changé

Lancé en septembre 2023, ce modèle compact a démontré qu’un LLM bien conçu peut largement surpasser des modèles de plus grande taille. Son architecture utilise deux techniques clés :

- Sliding Window Attention (SWA) : traite les longues séquences de façon plus efficace

- Grouped Query Attention (GQA) : accélère l’inférence

Open source, licence Apache 2.0, Mistral 7B peut tourner sur un laptop grand public avec 16 GB de RAM.

Mixtral 8x7B — Le Mixture of Experts révélateur

Publié en décembre 2023 avec le même flair (lien torrent Twitter), Mixtral 8x7B utilise une architecture Mixture of Experts (MoE) avec 46,7 milliards de paramètres totaux mais seulement 12,9B actifs par token. Résultat : des performances proches de GPT-3.5 avec la vitesse d’un modèle 3x plus petit.

Sur les benchmarks de raisonnement et de programmation, Mixtral 8x7B dépasse Llama 2 70B et est compétitif avec GPT-3.5 Turbo — tout en étant gratuit et déployable localement.

Mistral Large — Le modèle de pointe

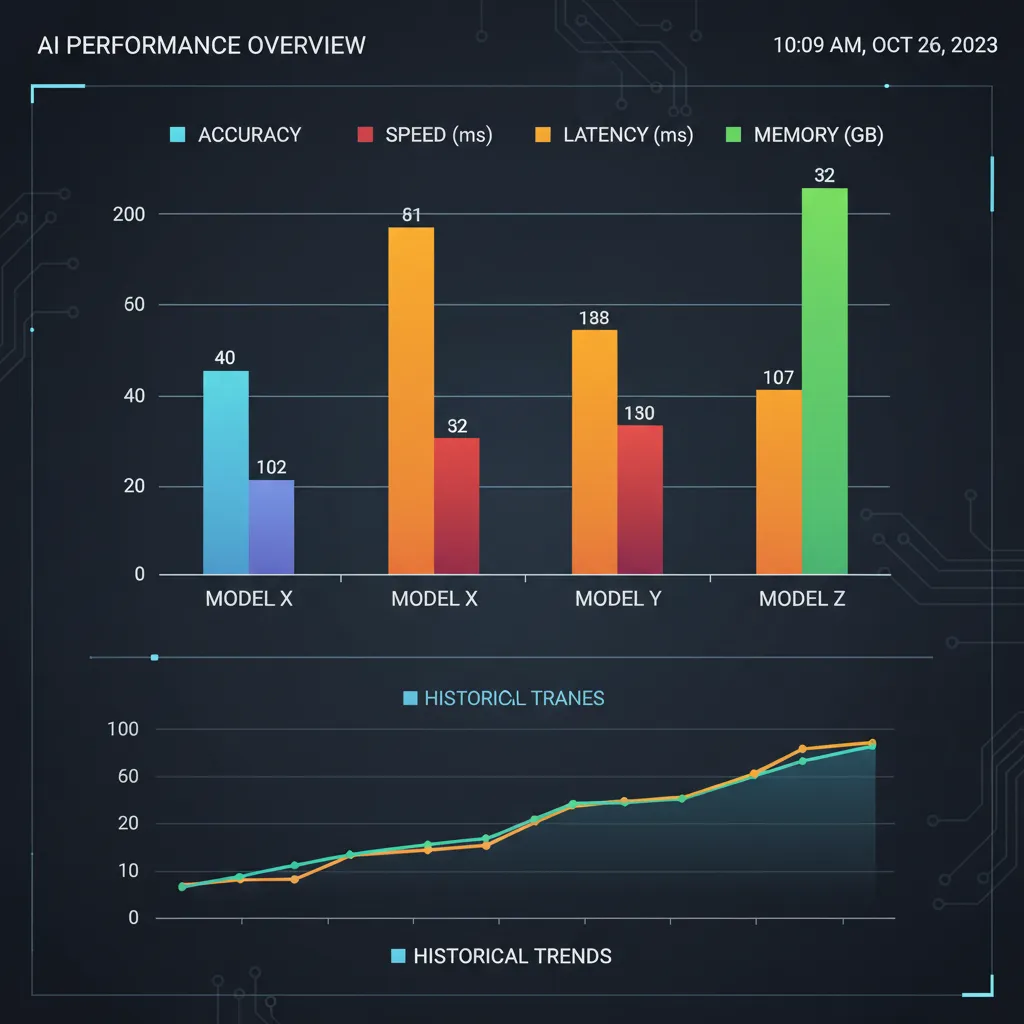

Mistral Large est le modèle propriétaire haut de gamme de Mistral, disponible via l’API payante. Ses performances sont comparables à GPT-4 sur la plupart des benchmarks :

- Mathématiques (MATH) : 45% (vs 42% pour GPT-4)

- Raisonnement (MMLU) : 81,2% (vs 86,4% pour GPT-4)

- Code (HumanEval) : 45,1%

Sa caractéristique distinctive : une maîtrise native du français exceptionnellement bonne, ce qui en fait le meilleur modèle pour les entreprises françaises et francophones.

Codestral — Spécialisé pour le code

Lancé en mai 2024, Codestral est le modèle de Mistral dédié à la programmation. Avec 22 milliards de paramètres et une spécialisation sur 80+ langages de programmation, il s’intègre dans VS Code et JetBrains via Continue.dev.

Performances sur HumanEval : 81,1% — supérieur à GPT-4 dans ce domaine précis.

Mistral Embeddings et autres modèles spécialisés

Mistral propose également :

- Mistral Embed : modèle d’embeddings pour la recherche sémantique et les applications RAG

- Mistral Nemo (12B, en partenariat avec NVIDIA) : modèle accessible, multilingue

- Pixtral : modèle multimodal capable d’analyser des images

Le Chat : l’interface grand public de Mistral

Le Chat (chat.mistral.ai) est l’interface conversationnelle de Mistral, accessible gratuitement. En 2026, elle propose :

Fonctionnalités gratuites

- Accès à Mistral Large pour les conversations générales

- Navigation web en temps réel

- Génération d’images (via un modèle partenaire)

- Support de documents (PDF, texte)

- Mode canvas pour rédiger et collaborer sur des documents

Le Chat Pro (15€/mois)

- Accès prioritaire aux modèles les plus récents

- Historique illimité

- Collaboration en équipe

- API incluse avec quota mensuel

Le Chat Enterprise

Solution pour les entreprises européennes qui souhaitent garder leurs données en Europe, avec :

- Hébergement en France ou en Allemagne

- RGPD natif

- Pas d’utilisation des données pour l’entraînement

- Déploiement sur cloud privé possible

C’est l’argument massue de Mistral face à OpenAI et Google pour les entreprises européennes soumises au RGPD. Pour voir comment Mistral se positionne dans l’écosystème global, consultez notre guide des meilleurs outils IA 2026.

Mistral vs les autres IA : où se situe-t-il ?

| Modèle | Éditeur | Open Source | Prix API (output) | Force |

|---|---|---|---|---|

| Mistral Large | Mistral AI 🇫🇷 | ❌ | 6$/M tokens | Français, RGPD |

| Mixtral 8x7B | Mistral AI 🇫🇷 | ✅ Apache 2.0 | Gratuit/auto-hébergé | Rapport qualité/coût |

| GPT-4o | OpenAI 🇺🇸 | ❌ | 15$/M tokens | Multimodalité, plugins |

| Claude 3.5 Sonnet | Anthropic 🇺🇸 | ❌ | 15$/M tokens | Raisonnement, sécurité |

| Gemini 2.0 Pro | Google 🇺🇸 | ❌ | 3,5$/M tokens | Contexte géant, Google |

| DeepSeek-V3 | DeepSeek 🇨🇳 | ✅ | 1,10$/M tokens | Coût, code |

Pour une comparaison détaillée des assistants IA, consultez notre comparatif Claude vs ChatGPT.

Pourquoi Mistral AI est stratégiquement important pour l’Europe

La souveraineté numérique en jeu

L’IA est en train de devenir une infrastructure aussi critique que l’électricité ou internet. Si l’Europe dépend entièrement de modèles américains (OpenAI, Google, Anthropic) ou chinois (DeepSeek, Baidu), elle perd une partie de sa souveraineté numérique et économique.

Mistral AI représente l’unique champion européen d’envergure mondiale dans ce domaine. Son soutien reçu de la BPI (Banque Publique d’Investissement) et sa localisation parisienne en font un acteur d’intérêt stratégique national.

La conformité RGPD native

Pour les entreprises européennes, utiliser Mistral présente un avantage concret : les données restent en Europe, sous le régime juridique du RGPD, sans risque de transfert vers les États-Unis soumis au CLOUD Act américain.

Les hôpitaux, cabinets d’avocats, banques et administrations françaises ont des raisons légales de préférer Mistral à ses alternatives américaines pour certains usages.

L’open source comme philosophie

La décision de Mistral de publier ses modèles en open source n’est pas que philosophique — c’est aussi une stratégie de distribution efficace. Des dizaines de milliers de développeurs utilisent Mixtral sur leurs serveurs, créent des applications, contribuent à la communauté. Cette adoption massive crée une barrière à la concurrence sans coût d’acquisition.

Comment utiliser Mistral AI : guide pratique

Option 1 : Le Chat (débutants)

Rendez-vous sur chat.mistral.ai — accès immédiat sans inscription requise. Interface propre et réactive, en français natif.

Option 2 : API Mistral (développeurs)

import mistralai

client = mistralai.Mistral(api_key="VOTRE_CLE_API")

response = client.chat.complete(

model="mistral-large-latest",

messages=[

{

"role": "user",

"content": "Explique le machine learning en 3 paragraphes"

}

]

)

print(response.choices[0].message.content)Tarifs API (avril 2026) :

- Mistral 7B : 0,25$/M tokens entrée, 0,25$/M sortie

- Mixtral 8x7B : 0,70$/M tokens entrée, 0,70$/M sortie

- Mistral Large : 4$/M tokens entrée, 12$/M sortie

Option 3 : Déploiement local (Ollama)

ollama pull mistral # Mistral 7B

ollama pull mixtral # Mixtral 8x7B

ollama pull codestral # Mistral pour le code

ollama run mistralMixtral 8x7B nécessite environ 26 GB de RAM pour tourner localement. Mistral 7B tourne sur n’importe quel laptop avec 8-16 GB de RAM. Si vous préférez déployer sur un serveur distant plutôt qu’en local, Meilleur Hébergement compare les solutions d’hébergement adaptées aux projets IA en Suisse et en Europe.

Pour intégrer Mistral dans vos workflows d’automatisation, notre guide sur l’automatisation avec Zapier et l’IA vous donnera les bases nécessaires.

Les cas d’usage où Mistral excelle

Rédaction en français

Mistral Large est sans doute le meilleur modèle du marché pour produire du texte en français nuancé, idiomatique et naturel. Ses créateurs sont francophones natifs et ont accordé une attention particulière à cette langue.

Traitement de données sensibles

Pour les entreprises avec des contraintes RGPD strictes (santé, finance, juridique), déployer Mixtral sur ses propres serveurs est la solution idéale : zero-trust, aucune donnée externe.

Applications RAG (Retrieval Augmented Generation)

Mistral Embed combiné à Mistral Large ou Mixtral 8x7B forme une architecture efficace pour créer des chatbots documentaires qui “connaissent” votre base de données interne.

Formation et éducation

Pour les contextes d’apprentissage, la clarté des explications en français de Mistral Large est un vrai atout. Lisez notre article sur l’IA dans l’éducation pour des stratégies pédagogiques adaptées.

Conclusion : Mistral AI, un acteur indispensable

Mistral AI a réussi ce qui semblait impossible en 2023 : créer en quelques mois des modèles de classe mondiale depuis Paris, les publier en open source, et s’imposer comme une alternative crédible aux géants américains.

En 2026, Mistral est clairement le choix numéro un pour :

- Les entreprises françaises et européennes soucieuses du RGPD

- Les développeurs qui cherchent des modèles open source performants

- Quiconque a besoin d’une qualité exceptionnelle en langue française

Pour suivre les dernières avancées de Mistral et de l’IA en général, retrouvez notre récapitulatif des actualités IA 2026.

En résumé :

- ✅ Performances comparables à GPT-4 (Mistral Large)

- ✅ Modèles open source de référence (Mistral 7B, Mixtral 8x7B)

- ✅ Meilleure qualité en langue française du marché

- ✅ Hébergement en Europe, conformité RGPD native

- ✅ API compétitive en prix

- ⚠️ Mistral Large (propriétaire) reste plus cher que les alternatives open source

- ⚠️ Écosystème moins mature qu’OpenAI (moins de plugins, d’intégrations)

Newsletter

Recevez chaque semaine les dernieres actualites IA, tutoriels et astuces directement dans votre boite mail.

Pas de spam. Desabonnement en un clic. Politique de confidentialite

Articles similaires

DeepSeek : l'IA chinoise qui défie ChatGPT (guide complet 2026)

DeepSeek est l'IA chinoise open source qui rivalise avec GPT-4o à une fraction du coût. Guide complet : fonctionnalités, performances, utilisation et comparatif.

Lire l'article

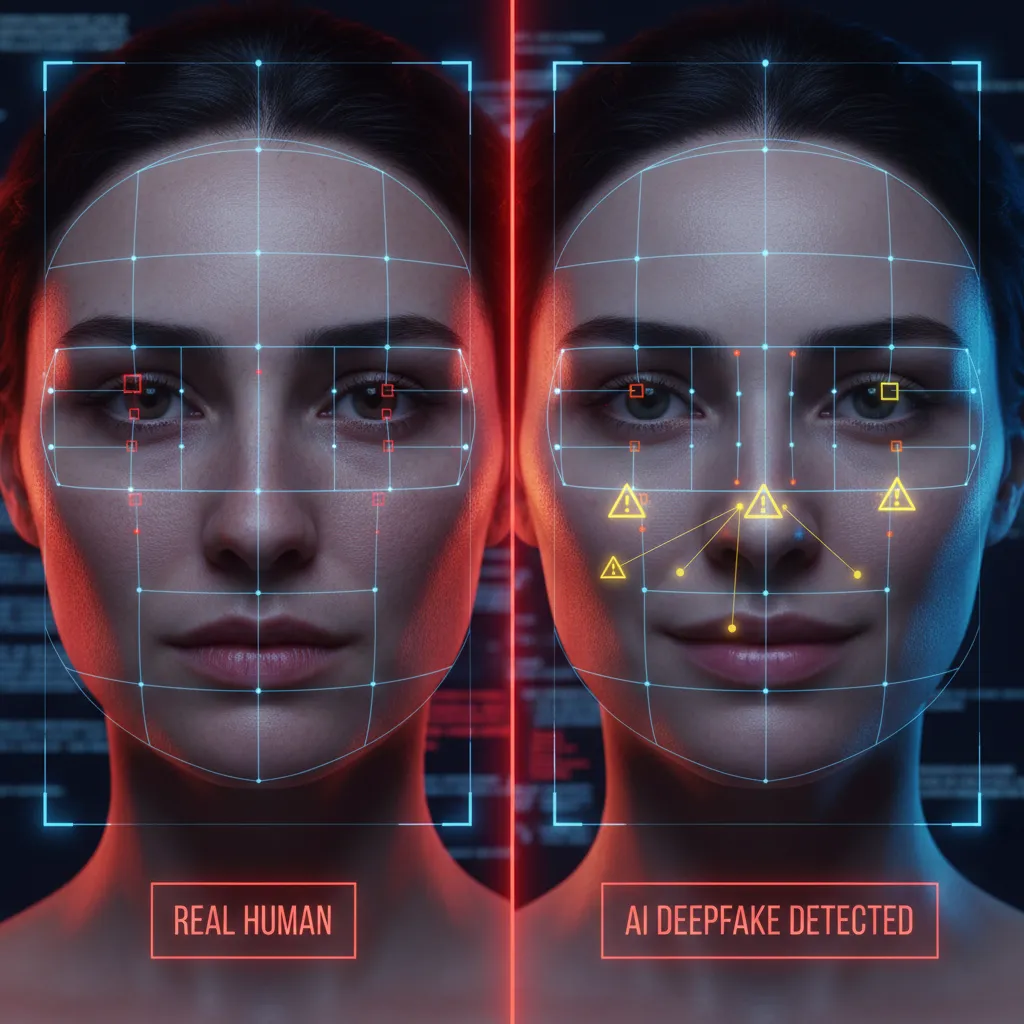

Deepfakes et IA : comment les reconnaître et se protéger en 2026

Les deepfakes générés par IA sont de plus en plus difficiles à détecter. Guide complet : comment identifier une vidéo ou photo IA, outils de détection, arnaques et protection.

Lire l'article

Grok : l'IA d'Elon Musk qui dit ce que les autres n'osent pas

Grok est l'IA d'xAI, la startup d'Elon Musk. Guide complet : accès gratuit sur X, Grok 3, différences avec ChatGPT, mode sans filtre et pourquoi tout le monde en parle.

Lire l'article